阿里林俊旸离职风波深度解读:大模型时代,Infra 困局背后的"AI-Native"组织之争

📖 导读

近日,阿里通义千问(Qwen)大模型技术负责人林俊旸离职的消息在整个科技圈引发热议。据悉,这位大模型顶尖人才的离开,不仅是个人职业的选择,更深刻反映了阿里等传统互联网大厂在通往 "AI-Native(AI原生)" 组织转型过程中,算法与基础设施(Infra)之间难以调和的结构性矛盾。

Toolswith.ai 编辑部通过访谈多位业界人士及多方渠道获悉,这场变动的核心诱因之一,是林俊旸对"自建 Infra 团队"以追求极致迭代效率的坚持,与阿里现有组织架构之间的直接冲突。在大模型竞赛进入白热化的今天,当"算法等排期"成为常态,甚至自家 Infra 效能不及竞对开源框架时,关于"AI 原生组织"定义的结构性博弈终于走到了爆发点。本文将透过现象看本质,为您带来深度的 AI 原生层面思考。

一、 核心人物离职,引爆 Infra "深层矛盾"

作为通义千问大模型研发的灵魂人物,林俊旸的离职在圈内引发了巨大震动。据内部知情人士透露,林俊旸此前曾极力推动在 Qwen 团队内部建立第三方的 Infra(基础设施)团队。为了确保模型迭代的极致速度,他甚至已经超前储备了一批相关方向的技术人才。

据《晚点 LatePost》报道,Qwen 模型团队从去年中开始尝试组建自己的 Infra 团队。此前,这部分工作主要由阿里云的人工智能平台 PAI 负责,而 PAI 需同时支撑来自通义实验室不同团队的多元化 Infra 需求。然而,这一旨在实现 "算法、工程一体化" 的提议最终未能获得阿里高层的批准。林俊旸的离职,被外界解读为技术理想主义与大厂传统组织架构之间的一次激烈碰撞。

二、 慢半拍的"排期":被扼杀的迭代速度

在基座大模型的竞赛中,速度就是生命。然而,阿里当前的组织架构却在无形中成为了 Qwen 加速的"阻力"。

据接近 Qwen 团队的人士爆料,目前的研发流程显得较为臃肿:算法同学在进行模型改进时,必须依赖于独立的 Infra 部门(如 PAI 平台团队)提供工程支持。这意味着,算法端一个简单的改进测试,往往需要先向 Infra 团队提需求、走流程,再等待对方的"排期"。这种模式深植于阿里的传统互联网架构中——阿里曾在中国互联网界率先推崇"大中台"概念,但在大模型时代,这种强调跨部门复用、资源统一调度且伴随复杂协调成本的中台思维,显然已无法适应大模型毫秒必争的迭代节奏。

"一个本该在几天内完成的迭代实验,往往因为跨部门协作和排期问题,拖上数周甚至更久。"

这种算法与工程的高度分离,导致 Qwen 在快速演进的全球大模型竞赛中,难以发挥出应有的灵活性与爆发力。

三、 遭"友商"降维打击:VeRL 事件背后的尴尬

更令内部感到沉重的是技术底座的实战差距。据悉,在 Qwen 模型的后训练(Post-training)阶段,由于阿里 PAI 团队提供的 Infra 架构存在诸多潜在问题,导致模型效果一度无法达到预期。

令人尴尬的是,林俊旸团队在尝试使用字节跳动开源的强化学习框架 VeRL 后,模型效果立竿见影地得到了提升。自家平台的工程底座在核心效能上不如竞争对手的开源工具,这一事实不仅刺痛了技术团队的自尊,更赤裸裸地暴露了阿里目前"算法与工程割裂"的组织缺陷。

四、 全球共识:当"研究"与"工程"的藩篱逐渐消失

林俊旸对 Infra 独立性的执着,并非孤立的技术理想主义,而是正成为全球顶级 AI 实验室的共识:在大模型时代,算法与工程正迅速融为一体。

1. OpenAI 翁家翌:Infra 决定了公司的"生死线"

OpenAI核心成员翁家翌在近期的访谈中表达了极其硬核的工程观点。在他眼中,Infra 的地位几乎等同于大模型公司的"生死线"。

- "Infra 即命门":他反复强调一个核心逻辑——每家公司的 Infra 都有 Bug,谁修复的 Bug 越多,模型就能训练得越好。

- 规模化瓶颈并非算力:真正的瓶颈在于"还没把现有路线榨干"以及"Infra 仍存在大量 Bug"。谁能提升修 Infra Bug 的吞吐量,谁就能获得更快的正确迭代速度。

- Idea 很便宜,验证很贵:Idea 本身并不稀缺,核心竞争力在于"验证密度"——即单位时间内能验证多少个想法。而决定验证密度的,正是 Infra 是否足够正确、迭代是否足够快。

- 工程能力的培养更困难:他认为教一个研究员(Researcher)做好工程(Engineering),远比教一个工程师做好研究(Research)难得多。

2. Anthropic:崛起的"研究工程师"与反超之路

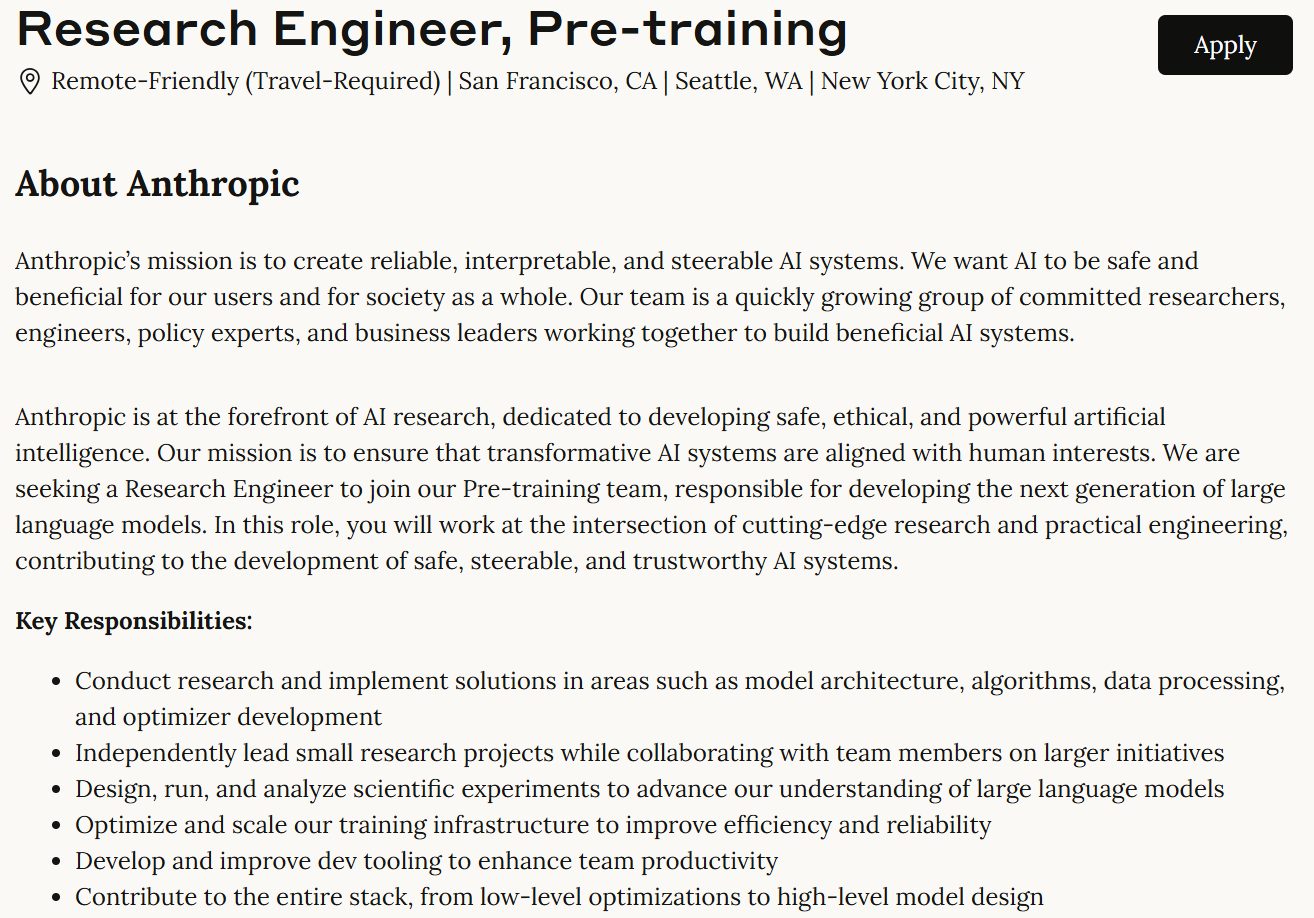

Anthropic 的崛起是其"研究工程师(Research Engineer)"人才战略的最强注脚。在其招聘说明中,有一句极具代表性的话:"在这里,工程师做大量的研究,而研究员则承担大量的工程。(One thing worth knowing: engineers here do lots of research, and researchers do lots of engineering)"

- 全栈职责与闭环迭代:岗位要求人才能够贡献于整个技术栈,从底层的低级优化到高层的模型设计。核心职责明确指向对训练基础设施(Infra)的持续优化与扩展。

- 极致速度下的全方位引领:正是依靠这种超高的迭代效率,Claude 系列模型实现了高速进化,甚至反超 OpenAI 的 GPT,登顶目前能力最强的大模型之位。同时,Anthropic 在 Agent(智能体)、Safety(AI安全)等前沿领域也引领了全球潮流。

▲ Anthropic 官网 Research Engineer 招聘页面,明确要求"贡献于整个技术栈,从底层优化到高层模型设计"

▲ Anthropic 官网 Research Engineer 招聘页面,明确要求"贡献于整个技术栈,从底层优化到高层模型设计"

3. xAI:彻底消灭"学术古董"术语

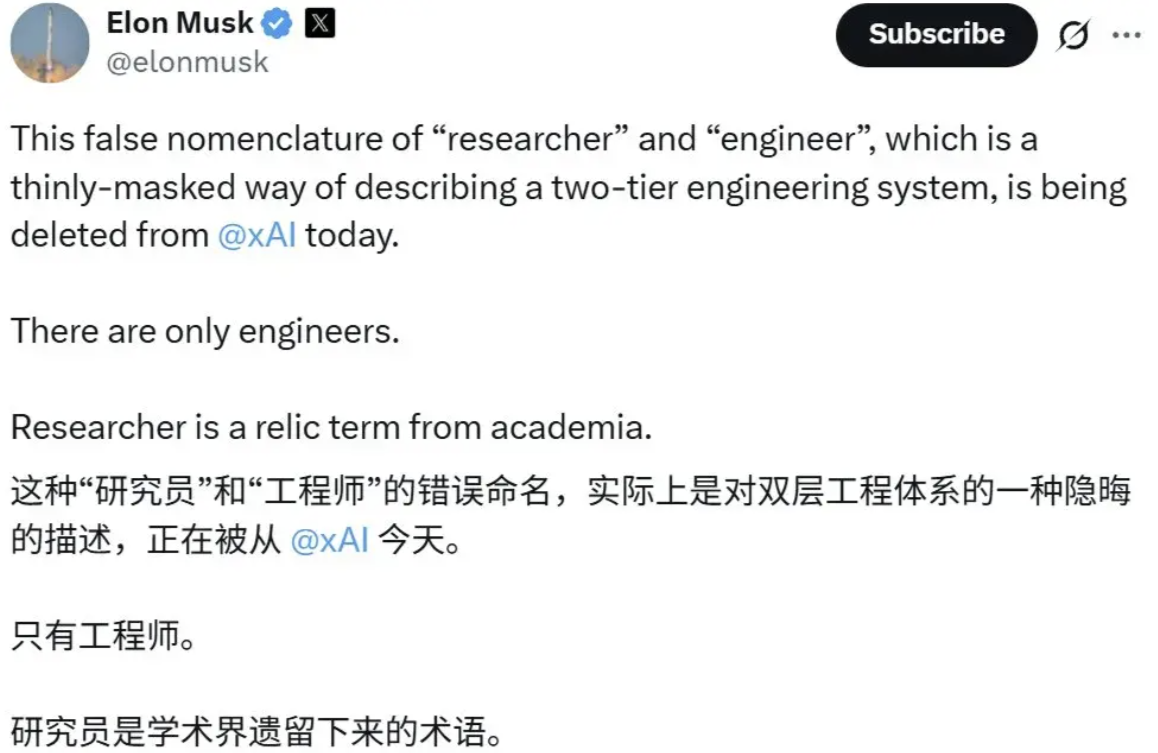

埃隆·马斯克(Elon Musk)在 xAI 采取了更为激进的组织实验,直接废除"研究员"与"工程师"的层级划分:

- 拒绝双层体系:马斯克认为,将人才区分为"研究员"和"工程师"本质上是对低效双层工程体系的一种隐晦描述。

- 唯一称谓:他直言"研究员(Researcher)"是学术界的古董术语,在 xAI "这里只有工程师(Engineer)"。这种极致的扁平化确保了算法改进能第一时间转化为工程实现。

▲ 马斯克在 X 上宣布:xAI 废除"研究员"称谓,"这里只有工程师"

▲ 马斯克在 X 上宣布:xAI 废除"研究员"称谓,"这里只有工程师"

虽然言论极具争议,但正是这种高度集成,让 xAI 能以惊人的速度搭建起万卡集群。作为后起之秀,Grok 大模型得以迅速跻身全球顶尖梯队。

结语:阿里离"AI-Native"组织还有多远?

林俊旸的离开,折射出传统大厂在大模型时代组织认知上的滞后。当硅谷巨头纷纷将"算法、工程、Infra"拧成一股绳,以追求极致的"验证密度"时,国内大厂若依然困于"中台思维"或"跨部门排期",即便是最顶尖的算法人才,也将面临"巧妇难为无米之炊"的困局。

通义千问若要真正登顶,阿里或许首先要手术的不是模型代码,而是对AI-Native组织更多深度的思考与重构。

📚 参考资料与引用

- [晚点 LatePost] 阿里Qwen人事变动:误读、近况、伏笔和未来

- [走进翁家翌] OpenAI,GPT,强化学习,Infra,后训练(Youtube链接:https://www.youtube.com/watch?v=I0DrcsDf3Os Spotify链接:https://open.spotify.com/episode/3WJoXs2hq06lV93sLSG461)

版权声明:本文由 Toolswith.ai 编辑部深度策划及撰写。未经授权,严禁转载或镜像,违者必究。